Dạo gần đây, tình trạng lợi dụng Deepfake để lừa đảo xuất hiện ngày càng rộng rãi. Người dùng cần tỉnh táo và xác minh thông tin về người yêu cầu chuyển tiền.

Kẻ xấu thu thập dữ liệu cho Deepfake qua các ứng dụng có chân dung người dùng

Gần đây, thủ đoạn lừa đảo nhờ sử dụng công nghệ ngày càng tinh vi khiến người dùng dễ dàng mất cảnh giác. Công nghệ Deepfake với khả năng tạo ra khuôn mặt của một người dùng dựa vào trí tuệ nhân tạo. Kẻ lừa đảo đã lợi dụng công nghệ này và tạo ra các đoạn video với hình ảnh có chứa khuôn mặt nhân vật giống hệt như hình ảnh của người dùng muốn giả mạo để yêu cầu “nạn nhân” chuyển tiền.

Theo các chuyên gia công nghệ, thủ đoạn lừa đảo này sẽ “nở rộ” trong thời gian tới, do đó, người dùng cần phải hết sức cảnh giác với những cuộc gọi, tin nhắn yêu cầu chuyển tiền.

Bên cạnh đó, các chuyên gia công nghệ cũng giải thích rằng các đối tượng lừa đảo đã thực hiện thu thập, tìm kiếm các thông tin các nhân, hình ảnh, video có giọng nói được đăng tải trên mạng xã hội làm nguồn dữ liệu cho Deepfake tạo ra sản phẩm có độ chính xác cao.

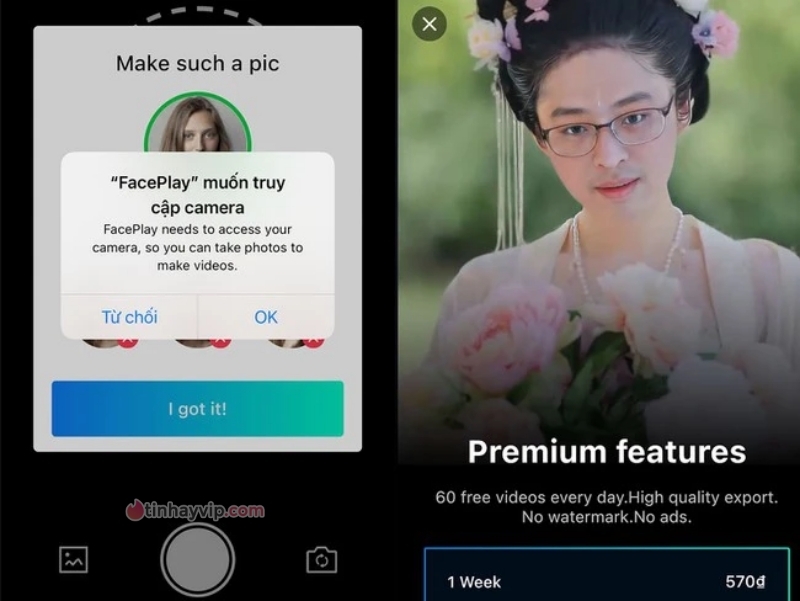

Không chỉ vậy, những trend ghép mặt mình vào các video có sẵn của các ứng dụng như Faceplay, Reface,… để trở thành các người mẫu, hoa hậu hay các cô gái xinh đẹp cổ trang của Trung Quốc cũng là một phương tiện để những kẻ lừa đảo lợi dụng làm nguồn dữ liệu của người dùng.

Vì vậy, người dùng hãy thật cảnh giác khi sử dụng bất kỳ ứng dụng có sử dụng các thông tin cá nhân và khuôn mặt của mình trên mạng xã hội.

Hãy truy cập TinhayVIP.com mỗi ngày để đón đọc thêm thông tin mới nhé!